昨日(6月3日),有消息显示,斯坦福团队被曝抄袭清华系大模型,目前已删库跑路。

该消息很快在中美AI领域引起轩然大波。

此前,很多AI圈的大佬们都提到,国内AI技术至少落后美国一到两年。他们可能不会想到,如此领先的美国AI界,竟然会反过来抄袭中国国产开源大模型。

尤其是斯坦福大学作为世界顶级名校,在人工智能领域的研究进展一直颇受外界关注。

比如,由李飞飞联合领导的斯坦福大学“以人为本人工智能研究院”(Stanford HAI)近期刚发布《2024 年人工智能指数报告》(Artificial Intelligence Index Report 2024),在业内传播量和口碑都极佳。

据了解,斯坦福某团队在5月29日刚发布Llama3-V,对外宣称只需500美元极客训出一个SOTA多模态大模型,比GPT-4V、Gemini Ultra、Claude Opus都强。

而Llama3-V的3位“开发者”(Aksh Garg、Siddharth、Mustafa),或有名校头衔加持,或有特斯拉、SpaceX等大厂背景,该项目一度受到了业界的极大关注。

但是有专业人士发现,通过对比Llama3-V与清华系明星创业公司面壁智能开源的MiniCPM-Llama3-V 2.5(人称“小钢炮”),发现两者的模型结构、代码、配置文件,几乎一模一样,仅仅是修改了变量名。

很快,面壁智能团队证实,斯坦福大模型项目Llama3-V与MiniCPM一样,可以识别出“清华简”战国古文字,“不仅对得一模一样、连错得都一模一样”。这一古文字数据为研究团队花费数月从清华简上逐字扫描并人工标注得来,并未对外公开。

这样一来,彻底证实:斯坦福大学AI团队主导的 Llama3-V 开源模型抄袭国内清华与面壁智能的开源模型MiniCPM-Llama3-V 2.5。

而更让人大跌眼镜的是,斯坦福团队第一时间的做法竟是删库跑路,丝毫没有世界顶级学府的严谨态度和责任心。

刚刚,迫于舆论压力,斯坦福Llama3-V团队的两位作者Siddharth Sharma和 Aksh Garg在社交平台上就这一学术不端行为向面壁MiniCPM团队正式道歉,并表示会将Llama3-V模型悉数撤下。

道歉内容如下:

“首先,我们要向MiniCPM原作者道歉。我、Siddharth Sharma,以及Mustafa一起发布了Llama3-V,Mustafa为这个项目编写了代码,但从昨天起就无法联系他。我与Siddharth Sharma主要负责帮助Mustafa进行模型推广。

我们俩查看了最新的论文,以验证这项工作的新颖性,但并未被告知或意识到OpenBMB(清华团队支持发起的大规模预训练语言模型库与相关工具)之前的任何工作。

我们向作者道歉,并对自己没有努力验证这项工作的原创性感到失望。我们对所发生的事情承担全部责任,并已撤下Llama3-V,再次致歉。”

对此,斯坦福人工智能实验室主任Christopher David Manning也发文谴责这一抄袭行为,并对MiniCPM这一中国开源模型表示赞扬。

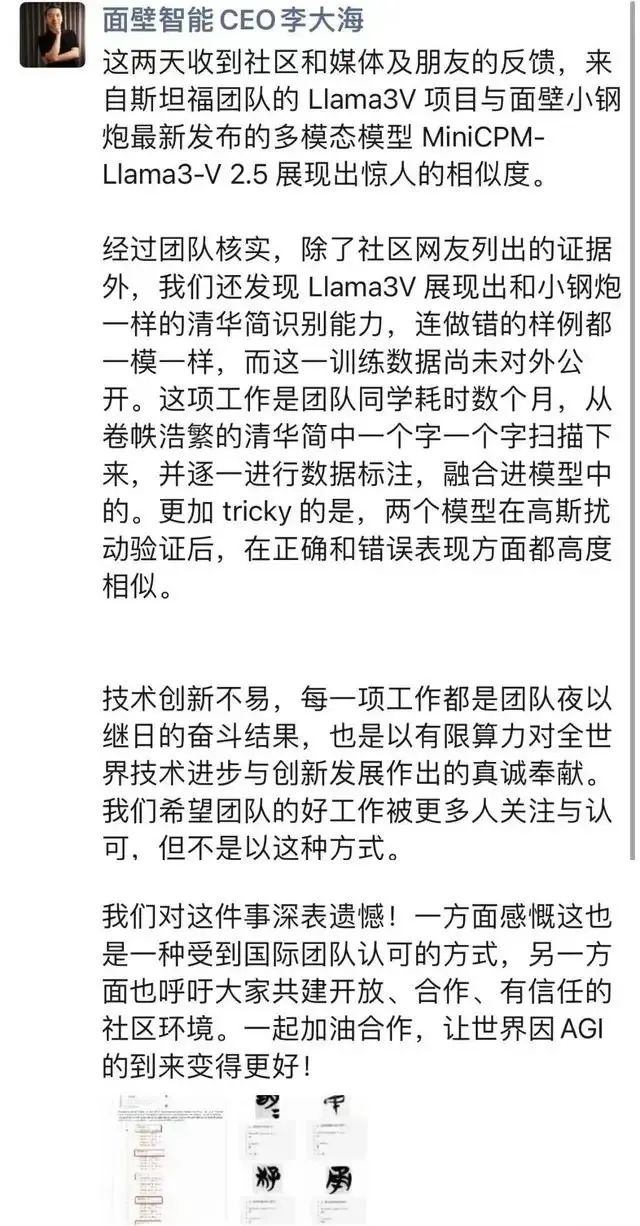

近日,面壁智能CEO李大海在朋友圈发文称:

这两天收到社区和媒体及朋友的反馈,来自斯坦福团队的 Llama3V 项目与面壁小钢炮最新发布的多模态模型 MiniCPM-Llama3-V 2.5 展现出惊人的相似度。

经过团队核实,除了社区网友列出的证据外,我们还发现 Llama3V 展现出和小钢炮一样的清华简识别能力,连做错的样例都一模一样,而这一训练数据尚未对外公开。这项工作是团队同学耗时数个月,从卷帙浩繁的清华简中一个字一个字扫描下来,并逐一进行数据标注,融合进模型中的。更加 tricky的是,两个模型在高斯扰动验证后,在正确和错误表现方面都高度相似。

技术创新不易,每一项工作都是团队夜以继日的奋斗结果,也是以有限算力对全世界技术进步与创新发展作出的真诚奉献。我们希望团队的好工作被更多人关注与认可,但不是以这种方式。

我们对这件事深表遗憾!一方面感慨这也是一种受到国际团队认可的方式,另一方面也呼吁大家共建开放、合作、有信任的社区环境。一起加油合作,让世界因AGI的到来变得更好!

面壁智能首席科学家、清华大学长聘副教授刘知远则表示:

人工智能的飞速发展离不开全球算法、数据与模型的开源共享,让人们始终可以站在SOTA的肩上持续前进。面壁开源的 MiniCPM-Llama3-V 2.5 就用了最新的Llama3 作为语言模型基座。

而开源共享的基石是对开源协议的遵守,对其他贡献者的信任,对前人成果的尊重和致敬,Llama3-V团队无疑严重破坏了这一点。他们在受到质疑后已在Huggingface删库,该团队三人中的两位也只是斯坦福大学本科生,未来还有很长的路,如果知错能改,善莫大焉。

5月28日,面壁智能联合创始人、CEO 李大海刚在演讲中分享了面壁「小钢炮」系列的最新进展:

日前发布的 MiniCPM-Llama3-V 2.5 是当前全球最强端侧多模态模型。以仅 8B 的体量,取得了超越多模态巨无霸 Gemini Pro 、GPT-4V 的多模态综合性能,并且实现了 OCR 能力 SOTA!

目前新一代「小钢炮」多模态模型已在端侧高效运行:通过首次端侧系统级多模态加速,实现了快 150 倍的图像编码速度提升。且量化后仅占用 8G 显存,4070 消费级显卡即可轻松推理,并可在手机端以 6-8tokens/s 速度高效运行。

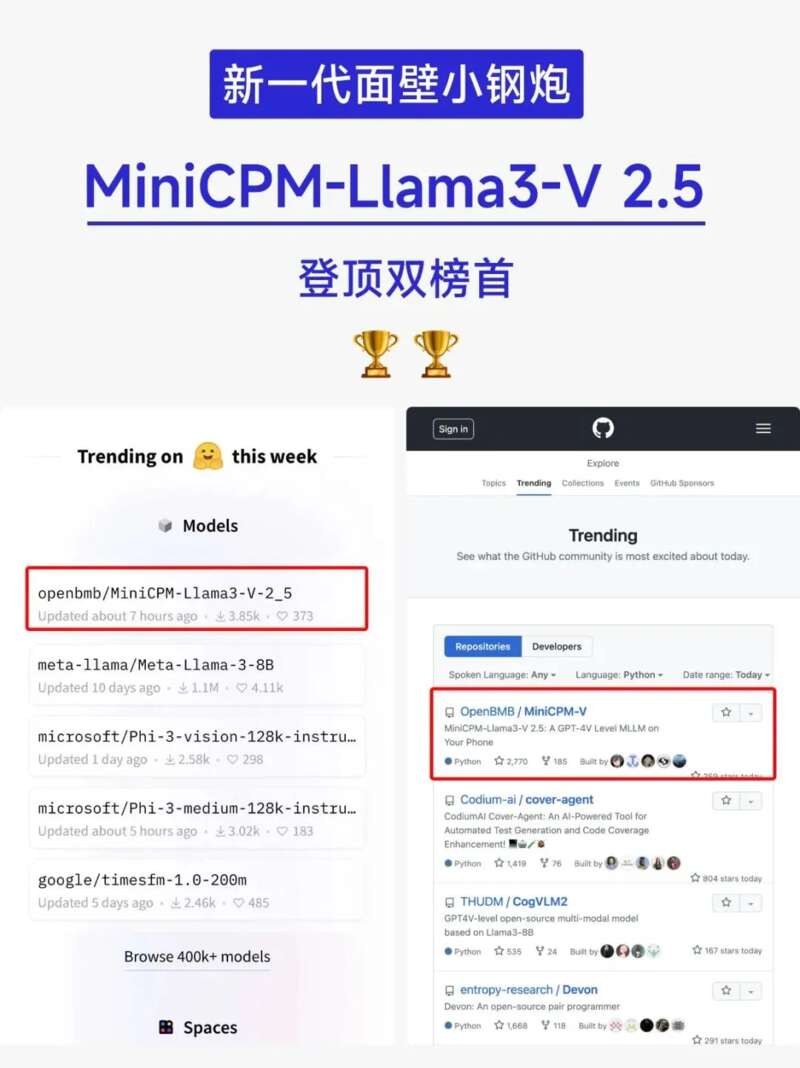

当前 MiniCPM-V 系列下载总量已超 13 万,GitHub 星标 3.9K。一经发布即广受到全球开源社区欢迎,火速登顶 HuggingFace 与 GitHub Trending 榜 Top1。

最后补充一下面壁智能的相关背景:

北京面壁智能科技有限责任公司成立于2022年8月,总部位于北京,公司深耕通用AI领域,专注大模型技术创新与应用转化。2020年12月,团队发布国内首个中文大模型CPM-1。面壁已面向公众发布千亿多模态大模型对话助手“面壁露卡Luca”。

面壁智能创始团队主要来自于清华大学自然语言处理实验室(THUNLP),公司CEO李大海还是知乎CTO(首席技术官);另一位公司联合创始人刘知远,则是清华大学计算机系副教授、博士生导师,研究方向为计算机自然语言处理;公司董事、CTO曾国洋为智源悟道·文源中文预训练模型团队骨干成员。

今年4月,面壁智能完成新一轮数亿元融资,由华为哈勃领投,春华创投、北京市人工智能产业投资基金等跟投,知乎作为战略股东持续跟投支持。今年2月,面壁智能发布开源模型MiniCPM后,又推出MiniCPM 2系列端侧模型。李大海表示,推动大模型在端侧的落地是面壁目前的重点工作之一。